发布日期:2026-03-17 12:10 点击次数:109

1、英伟达为何糜掷 200 亿好意思元收购一颗莫得 HBM 的 Groq 芯片,这背后对应着 AI 推理边界怎么的关节问题?

英伟达这次重金收购 Groq,本体是对准了AI 推理中最被冷漠的 Decode 阶段内存墙瓶颈,这亦然其在 GTC 大会前夜对本人推理居品体系的蹙迫布局。AI 推理分为 Prefill 输入处理和 Decode 逐 token 生成两个阶段,二者对硬件需求互异极大,Prefill 属于研究密集型任务,传统 GPU 发扬出色,但 Decode 是内存密集型任务,每生成一个 token 都要读取沿路历史 KV 缓存,对内存带宽和延伸相配明锐,GPU 在此递次恶果存在显然短板,而 Groq 的 LPU 语言处理单位恰是专诚贬责该问题的中枢居品,领略这款芯片,智力着实看懂英伟达改日的推理居品布局。

2、AI 推理为什么需要专诚面向 Decode 阶段的芯片,Prefill 和 Decode 两个阶段的硬件需求互异体面前何处?

跟着长凹凸文 AI 运用快速普及,超长文档分析、多轮对话、工程代码处理等场景束缚加多,Decode 阶段的瓶颈愈发隆起,必须要有专用芯片相沿。Prefill 阶段是对用户输入的问题、文本、代码等内容进行一次性处理,将其挪动为机器可领略的特征暗示,中枢是多数目矩阵乘法运算,属于高度并行的研究密集型任务,就像一次性读完一册书并索要中枢选录;而 Decode 阶段是基于 Prefill 礼貌逐字逐 token 生成回复,每生成一个 token 都要回溯读取通盘历史 KV 缓存,是串行且高度依赖内存的任务,如同说念话时要时刻回忆之前的沿路内容,凹凸文越长延伸越高,这种内存带宽需求呈指数级增长的问题,单纯堆加 GPU 算力压根无法贬责。

3、LPU 的中枢联想玄学是什么,和传统 GPU 的存储架构有哪些本体区别?

LPU 的联想中枢是破裂芯片存储墙,将存储单位平直面临研究单位,透彻区别于传统 GPU 的架构逻辑。传统 GPU 弃取研究单位、片上缓存、片外 HBM 高带宽内存的三级架构,数据读取需要经过多层传输,存在固定延伸;而 LPU 富裕断念片外 HBM,在芯片里面集成大容量 SRAM 行为中枢存储,让研究单位兑现近乎零延伸的数据读取,荒谬于把存储仓库平直建在分娩线上。同期 LPU 编译器会提前磋议好每个时钟周期的数据位置和研究任务,省去 GPU 多量领导诊治单位的面积,将更多空间留给 SRAM,以此兑现极低延伸,但该联想也存在显然代价,一是生动性较差,编译器需针对特定模子架构优化,模子迭代后要再行编译,二是 SRAM 本钱远高于 HBM,单套系统所需晶圆数目多,驱动插足本钱更高。

4、英伟达改日会弃取怎么的推理架构,GPU、CPX 与 LPU 会怎么单干合作?

A:英伟达将推出Prefill 与 Decode 鉴识的全新 PD 架构,让不同硬件各司其职,兑现最优本钱与恶果均衡。其中 CPX 弃取性价比更高的 GDDR 内存而非不菲 HBM,擅所长理研究密集型的 Prefill 任务;LPU 凭借片内 SRAM 的超低延伸特质,专诚肃肃内存密集型的 Decode 阶段;传统 GPU 则承担协同适配使命。这套组合有筹备的中枢逻辑是用最适配的硬件处理对应的任务,大发官方网站不再依赖单一 GPU 包揽沿路推理过程,能够大幅裁减举座 AI 推理的部署与运行本钱,构建起互异化的硬件竞争力。

5、面前 AI 推理的着实中枢瓶颈是什么,为何说贬责内存墙比堆砌算力更蹙迫?

A:当下 AI 推理的中枢矛盾早已不是算力不足,而是KV 缓存的存储与诊治恶果受限,这是行业盛大冷漠却至关蹙迫的痛点。AI 推感性能受算力、存储、传输三者组成的三角相关经管,Prefill 阶段的瓶颈在于算力,而 Decode 阶段的瓶颈则是内存带宽与延伸。如今模子调用量和生成 token 数目都在爆发式增长,长凹凸文场景更是让 KV 缓存限度急剧扩大,单纯堆砌 FLOPS 算力无法缓解内存传输压力,改日几年内,贬责存储墙、带宽墙问题,会比盲目晋升算力观点更能决定 AI 推理的施行性能与落地本钱。

6、LPU 的落地会带来哪些产业链增量观点,GTC 大会上可能深切哪些辩论有筹备?

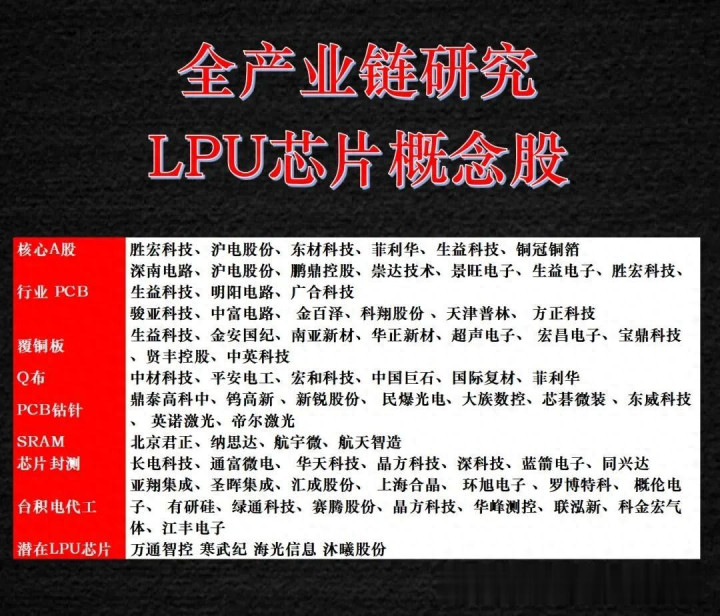

华体会体育(HTHSports)官网入口LPU 的限度化运用将带动四大中枢产业链观点升级,且 GTC 大会好像率会同步公布配套落地细节。一是 SRAM 边界,LPU 需集成多量片上 SRAM,改日可能引入 3D 堆叠工夫扩容,辩论产业链平直收益;二是 PCB 边界,LPU 的系统集成有筹备会鼓励 PCB 层数晋升、背部供电升级和新材料运用,高端 PCB 及上游材料需求增长;三是 Switch 互联边界,LPU 与 GPU 的协同需要新式互联架构,FPGA 等新有筹备有望落地;四是液冷边界,LPU 高集成度带来更高功耗密度,会加快液冷工夫普及,同期英伟达可能深切 SIB 独处 KV 缓存专用存储柜有筹备,此外推理系统中 CPU 的诊治与算子构建作用愈发蹙迫,辩论需求也会同步晋升。

7、LPU 行为英伟达对抗 ASIC 推理市集的火器,会怎么构建本人竞争壁垒?

LPU 并非独处居品,而是英伟达抵抗专用 ASIC 芯片竞争、守住通用推理市集的关节拼图。面前谷歌 TPU、亚马逊 Trainium 等专用推理 ASIC 正在束缚霸占市集份额,对英伟达的 GPU 生态酿成冲击,而英伟达将 LPU 纳入本人居品体系后,酿成GPU+CPX+LPU的组合化贬责有筹备,袒护不同推理场景的需求,不再是单一硬件竞争。同期依托熟悉浩大的 CUDA 软件生态,构建起硬件 + 软件的双重壁垒,既保捏了通用性上风,又补都了 Decode 阶段的专用性能短板,以此支吾专用 ASIC 的互异化竞争。

8、LPU 工夫与英伟达这次收购存在哪些潜在风险,需要要点关心哪些概略情味?

该布局存在五大中枢风险,会平直影响工夫落地与市集发扬。一是 LPU 系统本钱过高,片内 SRAM 本钱远高于 HBM,若无法有用摊薄本钱,市集接管度会大幅受限;二是软件栈兼容性挑战,LPU 编译器依赖特定模子架构优化,大模子快速迭代的布景下,生动性不足会成为中枢短板;三是 GTC 大会深切不足预期,若未明确 LPU 量产时辰与系统架构细节,市集预期会出现修正;四是 Groq 收购整合风险,200 亿好意思元大额收购存在团队会通、工夫适配的概略情味;五是 ASIC 竞争捏续加重,TPU v8、Trainium 3 等专用芯片同步升级,LPU 的互异化上风需要在施行部署中捏续考据。

Dafabet

Dafabet